|

|

|

|

|

|

|

|

е…ЁйғЁиҜҫзЁӢ >дәәе·ҘжҷәиғҪ |

|

RAGдёҺGraphRAGеӨ§жЁЎеһӢиҮӘе®ҡд№үзҹҘиҜҶй—®зӯ”еҺҹзҗҶдёҺе®һи·ө |

4383 ж¬ЎжөҸи§Ҳ  21 ж¬Ў 21 ж¬Ў

|

|

|

| ж—¶й—ҙең°зӮ№пјҡеҺҰй—Ёпјҡ8жңҲ14-15ж—ҘпјӣеҢ—дә¬гҖҒ

ж·ұеңігҖҒдёҠжө·ж №жҚ®жҠҘеҗҚејҖзҸӯ |

| иҜҫзЁӢиҙ№з”Ёпјҡ4500е…ғ/дәә |

|

|

|

| дјҒдёҡеҶ…и®ӯпјҡеҸҜд»Ҙж №жҚ®дјҒдёҡйңҖжұӮ,е®ҡеҲ¶еҶ…и®ӯ,иҜҰи§Ғ

еҶ…и®ӯеӯҰд№ жүӢеҶҢ |

|

|

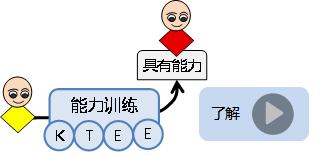

и®ӨиҜҒж–№ејҸпјҡ

еҹ№и®ӯеүҚдәҶи§ЈиғҪеҠӣжЁЎеһӢгҖӮ

еҹ№и®ӯеҗҺиҝӣиЎҢиғҪеҠӣиҜ„жөӢпјҡ

еңЁзәҝиҖғиҜ•

иғҪеҠӣеҲҶжһҗпјҢз»ҷеҮәеӯҰд№ е»әи®®

еҗҲж јиҖ…йўҒеҸ‘иҜҒд№ҰпјҢдҪңдёәиҒҢдёҡжҠҖиғҪиө„ж јиҜҒжҳҺ

|

|

|

|

| |

иҜҫзЁӢеҶ…е®№еңЁжҖ»з»“еӨ§жЁЎеһӢAIе·Ҙе…·зҡ„еҹәзЎҖдёҠпјҢиҜҰз»Ҷд»Ӣз»ҚеӨ§жЁЎеһӢзҡ„AgentжЁЎејҸгҖҒRLHFдёҺејәеҢ–еӯҰд№ зҡ„е…ізі»гҖӮ然еҗҺпјҢжҺўи®ЁchatGPTеҸҠе…¶иЎҚз”ҹжЁЎеһӢзҡ„еҺҹзҗҶпјӣжҺҘдёӢжқҘеј•е…ҘTransformersеә“иҝӣиЎҢд»Јз Ғе®һжҲҳгҖҒеӨ§жЁЎеһӢеҫ®и°ғд»Ҙжһ„е»әиҮӘе®ҡд№үзҹҘиҜҶзҡ„й—®зӯ”зі»з»ҹгҖӮиҝҷдёҖиҝҮзЁӢдёӯпјҢз»“еҗҲRAGдёҺGraphRAGиҝӣиЎҢзҹҘиҜҶеә“е’ҢзҠ¶жҖҒжңәзҡ„жһ„е»әгҖӮеңЁе®һи·өдёӯпјҢд»ҘеӨ§жЁЎеһӢеңЁе®һйҷ…йЎ№зӣ®дёӯзҡ„дҪҝз”ЁдёәеҮәеҸ‘зӮ№пјҢи®ҫи®Ўе®һж–Ҫж–№жЎҲе’Ңе®һйҷ…д»Јз Ғе®һзҺ°гҖӮиҜҫзЁӢж¶өзӣ–AIзј–зЁӢгҖҒеӣҫеғҸж–Үжң¬еӨ„зҗҶгҖҒAgentж„ҹзҹҘдёҺеҶізӯ–гҖҒchatGPTзҡ„зӣ‘зқЈеҫ®и°ғзӯүеӨҡдёӘж–№йқўпјҢеҢ…жӢ¬еҺҹзҗҶе’Ңе®һжҲҳдёӨйғЁеҲҶпјҢйҖҡиҝҮиҜҘиҜҫзЁӢпјҢеҸҜд»Ҙеҹәжң¬жҺҢжҸЎж·ұеәҰеӯҰд№ е’ҢеӨ§жЁЎеһӢзҡ„е…·дҪ“дҪҝз”ЁгҖӮ

|

иҜҫзЁӢзӣ®ж Үпјҡ

|

1. ж•ҙдҪ“жҠҠжҸЎRAGдёҺGraphRAGзҡ„еҸ‘еұ•ж–№еҗ‘

2. дәҶи§ЈRAGдёҺGraphRAGзҡ„жҠҖжңҜжЎҶжһ¶

3. зҗҶи§ЈRAGдёҺGraphRAGзҡ„жҖқз»ҙж–№ејҸе’Ңе…ій”®жҠҖжңҜ

4. дәҶи§ЈRAGдёҺGraphRAGеҪ“еүҚзҡ„иҗҪең°еә”з”Ё

5. дәҶи§ЈRAGдёҺGraphRAGжңҖж–°жҠҖжңҜзғӯзӮ№

|

| еҹ№и®ӯеҜ№иұЎпјҡ AIе·ҘзЁӢеёҲгҖҒж•°жҚ®еҲҶжһҗеёҲгҖҒ1е№ҙд»ҘдёҠе·ҘдҪңз»ҸйӘҢзҡ„з®—жі•е·ҘзЁӢеёҲгҖҒеҜ№жҠҖжңҜж„ҹе…ҙи¶Јзҡ„ITзЁӢеәҸе‘ҳгҖӮ |

| еӯҰе‘ҳеҹәзЎҖпјҡ

ж— зү№е®ҡиҰҒжұӮ |

жҺҲиҜҫж–№ејҸпјҡи®ІеёҲи®ІжҺҲ+зҺ°еңәи®Ёи®ә+жЎҲдҫӢеҲҶжһҗпјӢжЁЎеһӢи®Іи§Ј

|

еҹ№и®ӯеҶ…е®№пјҡ2еӨ©

|

дё»йўҳ

|

иҜҫзЁӢе®үжҺ’ |

| 第дёҖиҠӮпјҡеӨ§жЁЎеһӢAIе·Ҙе…·е’Ңе®һйҷ…еңәжҷҜжҸҗзӨәиҜҚпјҲ0.5hпјү

|

1. AIзј–зЁӢе·Ҙе…·пјҡиҮӘеҠЁд»Јз Ғз”ҹжҲҗдёҺзЁӢеәҸзјәйҷ·жЈҖжөӢиҪҜ件

2. AIеӣҫеғҸйҹіи§Ҷйў‘е·Ҙе…·пјҡеӣҫеғҸиҜҶеҲ«гҖҒи§Ҷйў‘зӣ‘жҺ§еҲҶжһҗиҪҜ件

3. AIи®ҫи®Ўе·Ҙе…·пјҡPPTгҖҒиЎЁж јзӯүзҡ„з”ҹжҲҗ

4. еӨ§жЁЎеһӢзҺҜеўғдёӢжөӢиҜ•з”ЁдҫӢзҡ„дҪҝз”Ё

5. дёҚеҗҢеӨ§жЁЎеһӢзҡ„йҖүеһӢ |

| 第дәҢиҠӮпјҡеӨ§жЁЎеһӢе’ҢAgentпјҲ1.5h-2hпјү

|

1. Agentж„ҹзҹҘзҺҜеўғгҖҒиҮӘдё»еҶізӯ–е’Ңз”ҹжҲҗиЎҢдёә

2. ејәеҢ–еӯҰд№ зҡ„жҖқи·Ҝе’ҢAgentжЁЎејҸ

3. ж„ҹзҹҘгҖҒжү§иЎҢгҖҒ规еҲ’гҖҒеҸҚйҰҲ

4. зҺҜеўғж„ҹзҹҘдёҺзҗҶи§Ј

5. д»»еҠЎжӢҶи§Је’ҢзҠ¶жҖҒиЎЁиҫҫ

6. 规еҲ’жү§иЎҢжӯҘйӘӨ

7. иҜ„дј°йЈҺйҷ©дёҺ收зӣҠ

8. иҮӘдё»еҶізӯ–дёҺ规еҲ’

9. иЎҢеҠЁжү§иЎҢдёҺеҸҚйҰҲ

10. еҚҸдҪңдёҺдәӨдә’

11. еӨҡAgentеҚҸдҪң

12. дҪҝз”ЁеӨ§жЁЎеһӢеҒҡAgentжЁЎејҸзҡ„е®һдҫӢ

13. вҖңжөӢиҜ•з”ЁдҫӢ-жөӢиҜ•-еҸҚйҰҲвҖқзҡ„й—ӯзҺҜAgentжЁЎејҸ

14. еҸҚйҰҲжңәеҲ¶зҡ„дҪҝз”Ё |

| 第дёүиҠӮпјҡ chatGPTеҸҠе…¶иЎҚз”ҹжЁЎеһӢзҡ„еҺҹзҗҶпјҲ0.5hпјү

|

1. зӣ‘зқЈеҫ®и°ғпјҲSFTпјүжЁЎеһӢгҖҒ

2. жҢҮзӨәеӯҰд№ е’ҢжҸҗзӨәеӯҰд№

3. з®ҖеҚ•жҸҗзӨәгҖҒе°Ҹж ·жң¬жҸҗзӨәгҖҒеҹәдәҺз”ЁжҲ·зҡ„жҸҗзӨә

4. жҢҮд»Өеҫ®и°ғ

5. RLLHFжҠҖжңҜиҜҰи§ЈпјҲд»Һдәәзұ»зҡ„еҸҚйҰҲдёӯеӯҰд№ пјү

6. иҒҡеҗҲй—®зӯ”ж•°жҚ®и®ӯз»ғеҘ–еҠұжЁЎеһӢпјҲRMпјү

7. ејәеҢ–еӯҰд№ еҫ®и°ғгҖҒPPO

8. InstructGPTйҒөеҫӘз”ЁжҲ·ж„ҸеӣҫдҪҝз”ЁејәеҢ–еӯҰд№ ж–№жЎҲ |

| 第еӣӣиҠӮпјҡ TransformersгҖҒеӨ§жЁЎеһӢеҸҠе…¶е®һжҲҳпјҲ2.5h-3hпјү

|

1. Hugging Face Transformersеә“жҳҜд»Җд№Ҳ

2. HuggingFaceзҪ‘з«ҷдёӯжЁЎеһӢзҡ„дёӢиҪҪе·Ҙе…·дҪҝз”Ё

3. GitеңЁWindowsзӯүйқһUbuntuзі»з»ҹзҡ„дҪҝз”Ё

4. LFSзӯүеӨ§ж–Ү件зҡ„еҝҪз•ҘдёӢиҪҪж–№ејҸ

5. еңЁHuggingFaceй•ңеғҸгҖҒmodelscopeйӯ”жҗӯзӯүзҪ‘з«ҷе®ҢжҲҗдёҠиҝ°е·ҘдҪңзҡ„ж–№жі•

6. AutoDLзҡ„дә‘е№іеҸ°дҪҝз”Ёе®һж“Қ

7. д»Ҙж„ҸеӣҫиҜҶеҲ«дёәдҫӢи§ЈйҮҠеӨҡз”ЁжҲ·еңәжҷҜзҡ„дҪҝз”Ё

8. е®ҢжҲҗйҖҡз”ЁеӨ§жЁЎеһӢзҡ„д»Јз Ғи·‘йҖҡгҖҒжҺЁзҗҶ

9. е®ҢжҲҗдә‘жЁЎеһӢеңәжҷҜдёӢзҡ„жЁЎеһӢжҺЁзҗҶд»Јз Ғ

10. Transformersе…ёеһӢдҪҝз”ЁеңәжҷҜ

11. TransformersжЁЎеқ—еҢ–и®ҫи®Ў

12. е®үиЈ…Transformersеә“

13. Transformers PipelineжөҒж°ҙзәҝ

14. ејҖз®ұеҚіз”Ёзҡ„Pipeline API

15. ејҖжәҗеӨ§жЁЎеһӢQwenзҡ„дҪҝз”Ё

16. Qwenй…ҚеҘ—зҡ„dashscopeеҢ…зҡ„дҪҝз”Ё

17. Qwen APIзҡ„и°ғз”Ёж–№ејҸ

18. Qwen2 VLеңЁеӨҡжЁЎжҖҒзҡ„и°ғз”Ёе’Ңе®һи·ө

19. дҪҝз”ЁMarkdownеҜ№Qwenиҫ“еҮәз»“жһңиҝҮж»Ө

20. з»“еҗҲжҸҗзӨәиҜҚгҖҒеӨ§жЁЎеһӢAPIгҖҒSQLиҜӯеҸҘзҡ„з»јеҗҲиҝҗз”Ё |

| 第дә”иҠӮпјҡеӨ§жЁЎеһӢеҫ®и°ғпјҡиҮӘе®ҡд№үзҹҘиҜҶзҡ„й—®зӯ”зі»з»ҹпјҲ2.5hпјү |

1. еӨ§жЁЎеһӢеҫ®и°ғйңҖиҰҒзҡ„ж•°жҚ®еҜ№

2. еӨ§жЁЎеһӢеҫ®и°ғдҪҝж•°жҚ®йҮҸзҡ„е»әи®®

3. 硬件иө„жәҗе»әи®®

4. жЁЎеһӢеҫ®и°ғзҡ„еҮ дёӘжӯҘйӘӨ

5. дҪҝз”ЁжңҚиЈ…жҸҸиҝ°зҡ„е®һйҷ…жЎҲдҫӢи§ЈйҮҠеӨ§жЁЎеһӢзҡ„еҫ®и°ғ

6. жһ„е»әеһӮзӣҙйўҶеҹҹеӨ§жЁЎеһӢзҡ„йҖҡз”ЁжҖқи·Ҝе’Ңж–№жі•

(1) еӨ§жЁЎеһӢ+зҹҘиҜҶеә“

(2) PEFT(еҸӮж•°й«ҳж•Ҳзҡ„еҫ®и°ғ)

(3) е…ЁйҮҸеҫ®и°ғ

(4) д»Һйў„и®ӯз»ғејҖе§Ӣе®ҡеҲ¶

7. LangChainд»Ӣз»Қ

8. иҮӘе®ҡд№үзҹҘиҜҶеә“

9. д»Јз Ғе’ҢжЎҲдҫӢе®һи·өпјҡ

10. еҠЁжүӢе®һзҺ°зҹҘиҜҶй—®зӯ”жңәеҷЁдәә

11. LangChainжөӢиҜ•й—®зӯ” |

| 第е…ӯиҠӮпјҡRAGе’ҢGraphRAGиҮӘе®ҡд№үзҹҘиҜҶеә“пјҲ2h-2.5hпјү |

1. RAGзҡ„еӯҳеңЁд»·еҖје’ҢжЎҲдҫӢдёҫдҫӢ

2. еҰӮдҪ•дҪҝз”ЁRAGеўһејәеӨ§жЁЎеһӢзҡ„й—®зӯ”

3. еҗ‘йҮҸж•°жҚ®еә“еңЁRAGдёӯзҡ„йҮҚиҰҒдҪңз”Ё

4. FacebookејҖжәҗзҡ„FAISSжҸ’件еә“

5. еҗ‘йҮҸж•°жҚ®еә“Milvus

6. жңҖиҝ‘йӮ»жҗңзҙўANNSзӯүзҙўеј•ж–№ејҸ

7. еҗ‘йҮҸеҢ–и®Ўз®—еҸҜйҮҮз”Ёзҡ„ж–№ејҸ

8. еҗ‘йҮҸзҡ„зӣёдјјжҖ§еәҰйҮҸйҖүжӢ©

9. еӣҫеғҸи§Ҷйў‘йҹійў‘зӯүзҡ„зӣёдјјжҖ§жҗңзҙў

10. Pythonзӣёе…іеҢ…pyMilvusзҡ„е®үиЈ…е’ҢдҪҝз”Ё

11. RAGж–№жЎҲзҡ„ж–°еҸ‘еұ•GraphRAG

12. жҜ”иҫғпјҡRAGдёӯеӯҳеңЁзҡ„й—®йўҳд»ҘеҸҠдҪҝз”ЁGraphRAGеҗҺзҡ„ж•Ҳжһң

13. дҪҝз”ЁеӣҫзҪ‘з»ңж‘ҳиҰҒи§ЈеҶіжҖ»з»“жҖ§жҹҘиҜўд»»еҠЎзҡ„й—®йўҳ

14. и§ЈеҶіRAGзҹҘиҜҶеә“еҶ…е®№зјәеӨұзҡ„иЎҘе……

15. и§ЈеҶіRAG TopKжҲӘж–ӯжңүз”Ёж–ҮжЎЈзҡ„и§ЈеҶі

16. и§ЈеҶіRAGдёӯйҮҚжҺ’еәҸ/иҝҮж»Ө规еҲҷйҖ жҲҗзҡ„дёҠдёӢж–ҮдёҚжӯЈзЎ®

17. еҰӮдҪ•жҸҗй«ҳжңүз”ЁдҝЎжҒҜзҡ„иҜҶеҲ«зҺҮ

18. жҖқиҖғпјҡд»Җд№ҲеҸ«вҖңжңүз”ЁзҹҘиҜҶвҖқ

19. еҗ‘йҮҸж•°жҚ®еә“й—®зӯ”зҡ„и®ҫи®Ў

20. GraphRAGдёӯзҹҘиҜҶеҶІзӘҒзҡ„еӨ„зҗҶж–№ејҸ

21. еңЁLangChainдёӯеўһеҠ LLMGraphTransformerеә“

22. е°ҶдҪҝз”ЁLangchainиҪ¬жҚўеҲ°дҪҝз”ЁLangGraph

23. е…ӢжңҚLangChainдёӯзҹҘиҜҶй“ҫжқЎзҡ„йҷҗеҲ¶жҖқи·Ҝ

24. дҪҝз”ЁзҹҘиҜҶеӣҫз»“жһ„еёҰжқҘзҡ„жЈҖзҙўдјҳеҠҝ

25. дҪҝз”ЁNeo4jзҡ„е…·дҪ“зҹҘиҜҶжЎҲдҫӢи§ЈйҮҠзҹҘиҜҶжЈҖзҙўзҡ„иҝҮзЁӢ |

| 第дёғиҠӮпјҡеӨ§жЁЎеһӢзҡ„еҝ«йҖҹжҗӯе»әж–№жЎҲе’ҢжЎҲдҫӢпјҲ1h-1.5hпјү

|

1. жөӢиҜ•еңәжҷҜзҡ„дҪҺд»Јз ҒBotеҲӣе»ә

2. жөӢиҜ•е·ҘдҪңзҡ„еҮҶзЎ®жҖ§е’Ңеҝ«йҖҹиҝӯд»ЈжҖ§

3. BaaSзҡ„жҸҗжі•

4. дҪҝз”ЁCoze еҝ«йҖҹжҗӯе»әAI Bot

5. CozeдёҠеҲӣе»әBot

6. Cozeзҡ„BotжҸҗзӨәиҜҚзҡ„зј–еҶҷ

7. з»ҷBotй…ҚзҪ®е·Ҙе…·йӣҶпјҢз»ҷе®ҡе·ҘдҪңжөҒзЁӢ

8. Botзҡ„еҸ‘еёғе’ҢжөӢиҜ•дҪҝз”Ёе®һи·ө

9. Difyзҡ„дҪҝз”Ёе’ҢеҲӣе»әBot

10. DifyдёҠеҲӣе»әAIе·ҘдҪңжөҒ

11. RAGз®ЎйҒ“

12. Difyдёӯе…ідәҺLLMзҡ„й—®йўҳеҲҶзұ»еҷЁ

13. еҲӣе»әжЁЎеһӢе’ҢAgent

14. LLMзҡ„й…ҚзҪ®ж–№ејҸ

15. жЁЎеһӢз®ЎзҗҶ

16. 笔иҖ…дё»жҢҒзҡ„иӢҘе№ІеӨ®дјҒе·ҘдёҡеңәжҷҜзҡ„еӨ§жЁЎеһӢеә”з”ЁжЎҲдҫӢ

17. йЈҺз”өеӨ§жЁЎеһӢеҸҜз ”жҠҘе‘ҠгҖҒеҗҺиҜ„д»·жҠҘе‘Ҡзҡ„з”ҹжҲҗиҜҰз»ҶжҖқи·Ҝе’Ңе®һзҺ°ж–№жЎҲ |

|

| |

|

|

| |

|

|

|

4383 ж¬ЎжөҸи§Ҳ  21 ж¬Ў 21 ж¬Ў

|

| е…¶д»–дәәиҝҳзңӢдәҶиҜҫзЁӢ |

|

|

|

|

|

|

|